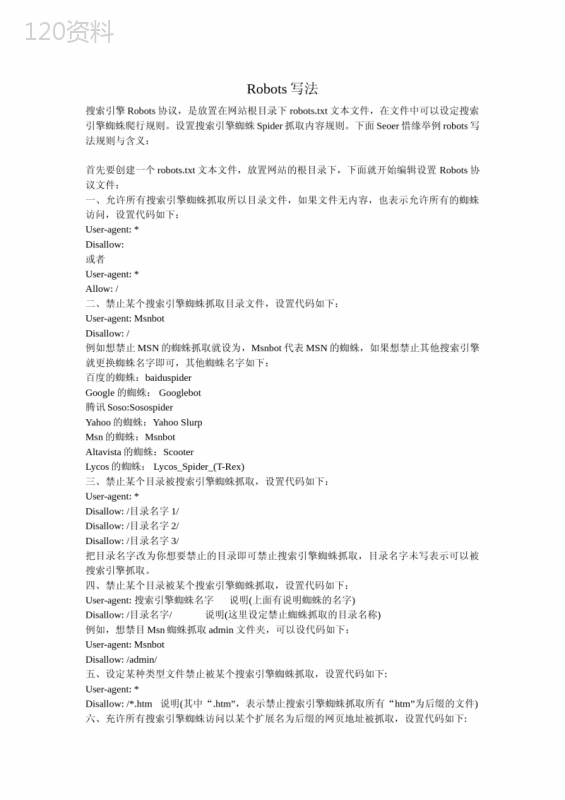

Robots写法

本作品内容为Robots写法,格式为 doc ,大小 23040 KB ,页数为 2页

('Robots写法搜索引擎Robots协议,是放置在网站根目录下robots.txt文本文件,在文件中可以设定搜索引擎蜘蛛爬行规则。设置搜索引擎蜘蛛Spider抓取内容规则。下面Seoer惜缘举例robots写法规则与含义:首先要创建一个robots.txt文本文件,放置网站的根目录下,下面就开始编辑设置Robots协议文件:一、允许所有搜索引擎蜘蛛抓取所以目录文件,如果文件无内容,也表示允许所有的蜘蛛访问,设置代码如下:User-agent:Disallow:或者User-agent:Allow:/二、禁止某个搜索引擎蜘蛛抓取目录文件,设置代码如下:User-agent:MsnbotDisallow:/例如想禁止MSN的蜘蛛抓取就设为,Msnbot代表MSN的蜘蛛,如果想禁止其他搜索引擎就更换蜘蛛名字即可,其他蜘蛛名字如下:百度的蜘蛛:baiduspiderGoogle的蜘蛛:Googlebot腾讯Soso:SosospiderYahoo的蜘蛛:YahooSlurpMsn的蜘蛛:MsnbotAltavista的蜘蛛:ScooterLycos的蜘蛛:Lycos_Spider_(T-Rex)三、禁止某个目录被搜索引擎蜘蛛抓取,设置代码如下:User-agent:Disallow:/目录名字1/Disallow:/目录名字2/Disallow:/目录名字3/把目录名字改为你想要禁止的目录即可禁止搜索引擎蜘蛛抓取,目录名字未写表示可以被搜索引擎抓取。四、禁止某个目录被某个搜索引擎蜘蛛抓取,设置代码如下:User-agent:搜索引擎蜘蛛名字说明(上面有说明蜘蛛的名字)Disallow:/目录名字/说明(这里设定禁止蜘蛛抓取的目录名称)例如,想禁目Msn蜘蛛抓取admin文件夹,可以设代码如下:User-agent:MsnbotDisallow:/admin/五、设定某种类型文件禁止被某个搜索引擎蜘蛛抓取,设置代码如下:User-agent:Disallow:/.htm说明(其中“.htm”,表示禁止搜索引擎蜘蛛抓取所有“htm”为后缀的文件)六、充许所有搜索引擎蜘蛛访问以某个扩展名为后缀的网页地址被抓取,设置代码如下:User-agent:Allow:.htm$说明(其中“.htm”,表示充许搜索引擎蜘蛛抓取所有“htm”为后缀的文件)七、只充许某个搜索引擎蜘蛛抓取目录文件,设置代码如下:User-agent:搜索引擎蜘蛛名字说明(上面有说明蜘蛛的名字)Disallow:',)

提供Robots写法会员下载,编号:1700774822,格式为 docx,文件大小为2页,请使用软件:wps,office word 进行编辑,PPT模板中文字,图片,动画效果均可修改,PPT模板下载后图片无水印,更多精品PPT素材下载尽在某某PPT网。所有作品均是用户自行上传分享并拥有版权或使用权,仅供网友学习交流,未经上传用户书面授权,请勿作他用。若您的权利被侵害,请联系963098962@qq.com进行删除处理。

下载

下载 下载

下载 下载

下载 下载

下载 下载

下载 下载

下载 下载

下载 下载

下载 下载

下载 下载

下载 下载

下载 下载

下载